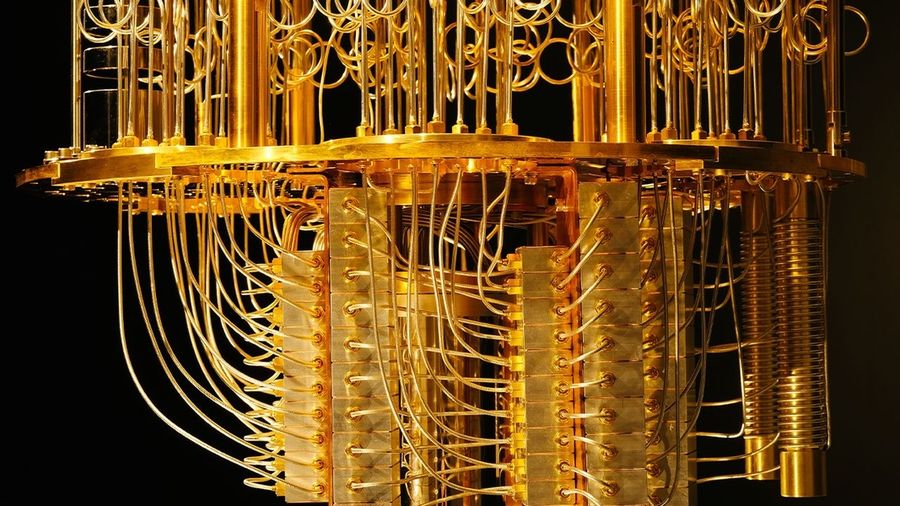

MIT 推出用于量子计算的编程语言 Twist

2022年1月下旬消息,麻省理工学院计算机科学与人工智能(CSAIL)的科学家开发了一种用于量子计算的新编程语言 —— Twist,专门用于解决数据纠缠问题,可以帮助开发人员减少误差并提高数据质量。

2022年1月下旬消息,麻省理工学院计算机科学与人工智能(CSAIL)的科学家开发了一种用于量子计算的新编程语言 —— Twist,专门用于解决数据纠缠问题,可以帮助开发人员减少误差并提高数据质量。与使用比特的传统计算机不同,量子计算机使用量子比特将信息编码为 0 或 1,或同时编码为 0 和 1。传统的编程语言并不适用于量子计算机,量子计算机需要一种合适的编程语言,以便开发者利用其能力。而对量子计算机进行编程需要了解一种叫做“纠缠”的东西,这是一种用于各种量子比特的计算乘数,它可以转化为强大的能量。

Twist 能以程序员可以理解的语言,描述和验证哪些数据在量子程序中被纠缠。这种语言使用了一个叫做“purity”的概念,它强制不存在纠缠并产生更直观的程序,理想情况下会减少错误。例如,程序员可以使用 Twist 表示程序作为垃圾生成的临时数据不会与程序的答案纠缠在一起,从而可以安全地丢弃。

麻省理工学院电气工程和计算机科学博士生、Twist 相关的论文的主要作者 Charles Yuan 称,“我们的语言 Twist 允许开发人员通过明确说明一个量子比特何时不得与另一个量子比特纠缠,来编写更安全的量子程序。因为理解量子程序需要理解纠缠,我们希望 Twist 为语言铺平道路,让程序员更容易应对来自量子计算的独特挑战。”

根据介绍,Twist 具有足够的表现力,可以为著名的量子算法写出程序,并识别其实现中的错误。为了评估 Twist 的设计,MIT 的科学家们修改程序,引入了一些对人类程序员来说相对微妙的错误,并表明 Twist 可以自动识别这些错误并拒绝这些程序。MIT 研究人员称,通过合并 Twist,在量子计算机上运行的程序的运行时间仅增加了 4%。

MIT 方面指出,接下来重要的是使用 Twist 来创建更高级别的量子编程语言。“今天的大多数量子编程语言仍然类似于汇编语言,把低级的操作串在一起,没有注意到像数据类型和函数这样的东西,以及经典软件工程中的典型。”

芝加哥大学计算机科学的 Seymour Goodman 教授和 Super.tech 的首席科学家 Fred Chong 称,量子计算机容易出错且难以编程。通过引入和推理程序代码的 purity,Twist 朝着简化量子编程迈出了一大步,它保证了纯代码中的量子比特不会被不在该代码中的比特所改变。

MIT推出新方法,显著提升大型语言模型计算效率

MIT研究团队2025年12月发布了一项创新的计算方法,旨在提高大型语言模型(LLM)的运算效率,同时降低能源消耗。这项名为实例自适应缩放的技术,可以根据提问的复杂程度调整计算资源。相关论文于 11 月初发布,得到了 MIT-IBM 沃森人工智能实验室、MIT-Amazon 科学中心、MIT-Google 计算创新项目以及 MathWorks 的支持。传统的大型语言模型在处理问题时,往往会使用固定的推理过程奖励模型(PRMs),这使得它们在面对不同复杂度的问题时,计算资源利用率不高,且常常高估成功的概率。

MIT 的研究人员通过重新设计 PRMs,使其能够根据不同的问题动态调整推理轨迹的数量。这样,简单的问题可以使用较少的计算资源,而复杂的问题则可以获得更多的推理支持。研究人员指出,人的思维过程往往是通过分解复杂问题、逐步推理和不断修正来进行的,而 LLM 也同样能从这一过程中获益,能够在推理时获得更多的 “思考” 时间。研究显示,采用这种新方法后,计算资源的使用量减少了一半,同时依然能够提供与现有模型相媲美的准确回答。此外,经过重新校准的 PRMs 也为较小的 LLM 提升了性能。

鉴于这一技术的成功,MIT 团队表示他们将进一步探索该方法在其他应用中的表现,如代码生成和人工智能代理,并计划探索 PRM 校准方法在强化学习等领域的更多应用。